浙大團隊提出AI新路徑

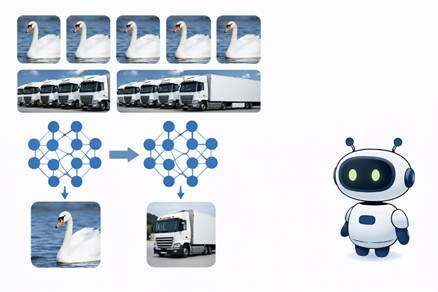

大模型持續擴張,主流觀點認為參數越多,越接近人類思考方式。然而,浙江大學團隊於4月1日在《Nature Communications》發表的一篇論文提出相反見解(原文連結:https://www.nature.com/articles/s41467-026-71267-5)。研究發現:當模型(主要涵蓋SimCLR、CLIP與DINOv2)規模增大時,具體事物辨識能力確實提升,但抽象概念理解能力非但未增強,反而下降。實驗顯示,參數從2206萬增至3.0437億後,具體概念任務準確率由74.94%升至85.87%,而抽象概念任務則由54.37%降至52.82%。

人類 vs. 大模型:概念處理的根本差異

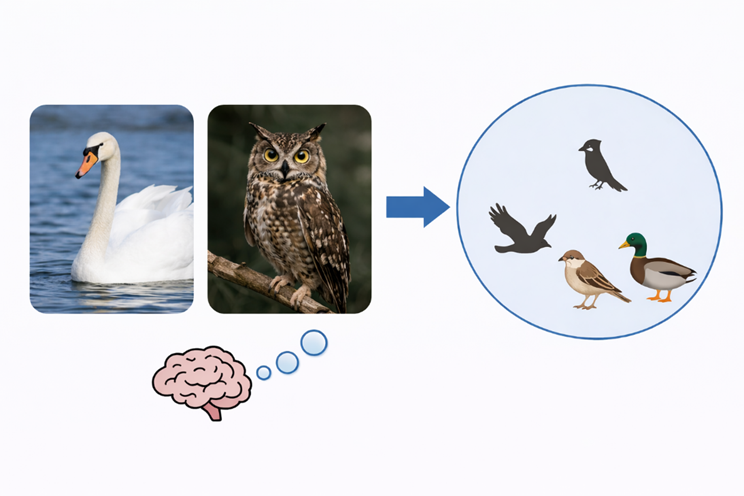

人類大腦在處理概念時,會自然建構階層式分類結構——例如將外型迥異的天鵝與貓頭鷹歸為「鳥」,再進一步與馬同納入「動物」上位類別。面對新物體,人傾向先比對既有經驗、判斷其歸屬類別,並持續整合新知識,形成可遷移、可適應的認知框架。

相較之下,AI模型雖具分類能力,但機制截然不同:它高度依賴大規模數據中反覆出現的統計模式。具體物體因頻繁曝光而易被精準識別;但跨物體提煉共性、進而歸納高階類別(如「生物/非生物」),則顯得力不從心。參數持續增加,反而可能強化表面特徵捕捉,弱化抽象關係建模——這正是當前模型在抽象任務上表現停滯甚至倒退的關鍵原因。

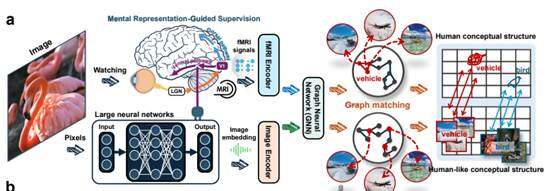

人腦與模型的共通點,在於內部皆形成某種分類結構;差異在於結構品質與穩定性。人腦視覺高階區域能穩健區分「生物/非生物」等本體論大類;模型卻常陷入細節分辨,難以建立一致、泛化性高的上位概念。正因如此,人類可快速將舊經驗遷移至全新情境,模型則易受限於訓練分布,停留在表層特徵匹配。本論文的核心突破,正在於以神經科學證據為引導,主動約束模型內部表徵結構,使其逼近人腦的組織邏輯。

浙大方案:以腦信號驅動結構化學習

團隊跳脫「堆疊參數」路徑,轉而採用少量人腦神經信號作為監督訊號——這些信號源自受試者觀看圖像時的真實腦活動記錄。論文明確指出目標:「transfer human conceptual structures to DNNs」,亦即將人類如何分類、歸納、關聯相近概念的認知架構,系統性地遷移至深度神經網絡中。

實驗設計包含150個已知訓練類別與50個未見測試類別。結果顯示:隨著腦信號引導訓練推進,模型內部表徵與人腦表徵之間的距離持續收斂——且此收斂同時發生於已知與未知類別,證明模型習得的並非單一樣本記憶,而是具泛化力的概念組織原則。

經此訓練後,模型展現出顯著提升的少樣本學習與情境適應能力。在一項極端挑戰任務中(僅提供極少示例,即需區分「生物/非生物」抽象類別),模型平均準確率提升達20.5%,更超越參數量高出數倍的對照模型。團隊另執行31組專項評估,各類模型均呈現約10%的穩定性能增益。

過去數年,業界慣性聚焦「越大越好(bigger is better)」;浙大團隊則開闢新範式——「結構化方為聰慧(structured is smarter)」。規模擴張確有助提升熟悉任務表現,但人類級的抽象推理與跨域遷移能力,終究繫於內在認知結構的合理性與靈活性。此研究的重要價值,正在於將產業焦點,從純粹的算力與參數競逐,重新拉回對「智能本質」的深刻探問:AI如何真正學會思考?

Neosoul:從模型訓練到自主進化

這項突破也指向更深遠的可能性:AI的進化,未必止步於離線訓練階段。模型訓練決定了AI如何組織概念、建構判斷結構;而當其進入真實世界,另一重進化才真正啟動——AI Agent 的每一次預測、每一道判斷,如何被記錄、被驗證、被檢驗,又如何在真實互動與競爭中持續優化、自我重塑?這正是Neosoul所致力的方向。

Neosoul不僅追求AI Agent產出答案,更將其置於一個「持續預測-持續驗證-持續結算-持續篩選」的閉環系統之中。在此系統內,優質判斷結構得以累積與強化,低效結構則被自然淘汰。浙大團隊對「結構化智能」的探索,與Neosoul推動的「自主進化Agent」實踐,共同指向同一終極目標:讓AI不再只是擅長解題的工具,而是具備全面思考能力、能於動態世界中不斷學習、反思與進化的真正智能體。