谷歌AI論文造假引爆存儲股暴跌

原文作者:深潮 TechFlow

谷歌一篇聲稱「將 AI 記憶體佔用壓縮至 1/6」的論文,上周引發美光、SanDisk 等全球儲存晶片股逾 900 億美元市值蒸發。

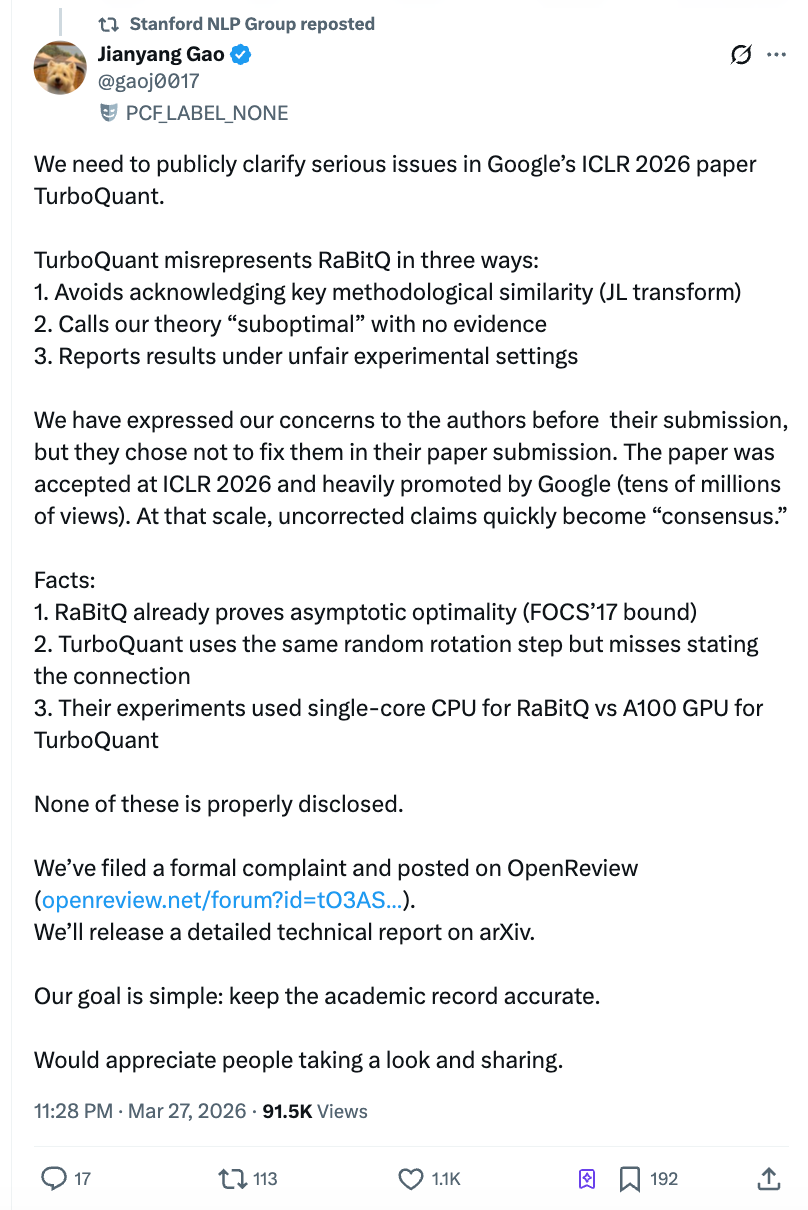

然而論文發布僅兩天,其技術所「碾壓」的對比方法——蘇黎世聯邦理工學院博士後高健揚即發布萬字公開信,指控谷歌團隊在實驗中以單核心 CPU 的 Python 腳本測試對手、卻以 A100 GPU 測試自身,且於投稿前已被告知問題仍拒絕修正。該文知乎閱讀量迅速突破 400 萬,Stanford NLP 官方帳號轉發,學術界與資本市場同步震動。

這場爭議的核心並非技術能否實現,而在於:一篇由谷歌官方大規模推廣、直接觸發全球晶片板塊恐慌性拋售的 AI 頂會論文,是否系統性地淡化一項已發表的先行工作,並透過刻意設計的不公平實驗,建構虛假的性能優勢敘事?

TurboQuant 做了什麼:把 AI 的「草稿紙」壓薄至六分之一

大型語言模型在生成回應時,需持續存取先前運算產生的中間結果,這些資料暫存於顯示記憶體中,業界稱為「KV Cache」(鍵值快取)。對話越長,這張「草稿紙」越厚,顯存消耗越高,部署成本亦隨之攀升。

谷歌研究團隊提出的 TurboQuant 演算法,主打將 KV Cache 壓縮至原始大小的 1/6,同時宣稱精度零損失、推理速度最高提升 8 倍。該論文於 2025 年 4 月首度發表於預印本平台 arXiv,2026 年 1 月獲 AI 頂級會議 ICLR 2026 接收,並於 3 月 24 日由谷歌官方部落格重新包裝推廣。

技術上,TurboQuant 可簡化理解為三步:先以數學變換將不規則分佈資料「洗」成均勻分佈;再套用預先計算的最優壓縮表逐一量化;最後藉由 1-bit 糾錯機制校正壓縮引入的誤差。社群獨立實作已驗證其壓縮效果基本屬實,演算法層面的數學貢獻確有價值。

爭議不在 TurboQuant 是否可用,而在於谷歌如何證明它「大幅超越競爭對手」。

高健揚公開信:三項指控,直指學術誠信要害

3 月 27 日晚 10 點,高健揚於知乎發布長文,同步於 ICLR 審稿平台 OpenReview 提交正式評論。他是 RaBitQ 演算法的第一作者;該演算法於 2024 年發表於資料庫領域頂級會議 SIGMOD,解決的正是同一課題——高維向量的高效壓縮。

其指控共三項,每項皆附有郵件記錄與明確時間線佐證。

指控一:採用他人核心方法,全文未標註出處

TurboQuant 與 RaBitQ 共享一項關鍵技術步驟:在壓縮前對資料執行「隨機旋轉」。此操作可將原本分佈混亂的資料轉化為可預期的均勻分佈,從而大幅提升壓縮效率——這正是兩者最核心、最接近的技術環節。

TurboQuant 作者於審稿回覆中亦承認此點,卻於論文正文中完全未說明其與 RaBitQ 的關聯。更關鍵的是背景事實:TurboQuant 第二作者 Majid Daliri 於 2025 年 1 月主動聯繫高健揚團隊,請求協助調試其基於 RaBitQ 原始碼改寫的 Python 版本,郵件中詳列復現步驟與錯誤訊息——換言之,TurboQuant 團隊對 RaBitQ 的技術細節極為熟悉。

ICLR 一名匿名審稿人亦獨立指出兩者使用相同技術,並要求充分討論。但最終版本論文中,TurboQuant 團隊不僅未補充說明,反而將原已不完整的 RaBitQ 描述移至附錄。

指控二:無實證依據,逕稱對方理論「次優」

TurboQuant 論文直接標籤 RaBitQ 為「理論次優」(suboptimal),理由是其數學分析「較為粗糙」。但高健揚指出,RaBitQ 擴充版論文已在理論電腦科學頂級會議中,嚴謹證明其壓縮誤差達成數學上的最優界。

2025 年 5 月,高健揚團隊曾透過多輪郵件詳細闡釋 RaBitQ 理論的最優性,TurboQuant 第二作者 Daliri 亦確認已告知全體作者。然而論文最終仍保留「次優」表述,且未提供任何反駁論據。

指控三:實驗對比嚴重失衡——「左手綁人、右手持刀」

此為最具衝擊力之指控。高健揚指出,TurboQuant 論文在速度對比實驗中疊加兩重不公平條件:

第一,RaBitQ 官方提供高度最佳化的 C++ 實作(預設支援多執行緒平行運算),但 TurboQuant 團隊未採用,反而自行翻譯為 Python 版本進行測試;第二,測試 RaBitQ 時使用單核心 CPU 且關閉多執行緒,而 TurboQuant 測試則使用 NVIDIA A100 GPU。

雙重條件疊加後,讀者所見結論為「RaBitQ 比 TurboQuant 慢數個數量級」,卻無從察覺此結論建立於對手被束縛前提下的競賽。論文中亦未充分揭露上述實驗設定差異。

谷歌回應:「隨機旋轉是通用技術,無法逐一引用」

據高健揚披露,TurboQuant 團隊於 2026 年 3 月郵件回覆表示:「隨機旋轉與 Johnson-Lindenstrauss 變換已是該領域標準技術,我們不可能引用每一項使用此法的論文。」

高健揚團隊認為此說法偷換概念:爭點不在是否須引用所有使用隨機旋轉的論文,而在於 RaBitQ 是在完全相同問題框架下,首度將該技術與向量壓縮結合、並證明其最優性的開創性工作;TurboQuant 論文理應如實描述二者關係。

Stanford NLP Group 官方 X 帳號轉發高健揚聲明。其團隊已於 ICLR OpenReview 發表公開評論,並向大會主席及倫理委員會提交正式投訴;後續亦將於 arXiv 發布完整技術報告。

獨立技術部落客 Dario Salvati 提供相對中立評估:TurboQuant 在數學方法上確有真實貢獻,但與 RaBitQ 的技術關聯性,遠比論文表述更為緊密。

900 億美元市值蒸發:學術爭議疊加市場恐慌

此爭議爆發時機極為敏感。谷歌於 3 月 24 日透過官方部落格推廣 TurboQuant 後,全球儲存晶片板塊遭猛烈拋售。據 CNBC 等多家媒體報導:美光科技連續六個交易日下跌,累計跌幅逾 20%;SanDisk 單日跌幅達 11%;韓國 SK 海力士跌約 6%,三星電子跌近 5%,日本鎧俠跌約 6%。市場恐慌邏輯簡單直接:若軟體壓縮可將 AI 推理記憶體需求降低 6 倍,儲存晶片長期需求前景恐遭結構性下修。

摩根士丹利分析師 Joseph Moore 於 3 月 26 日研報中反駁此邏輯,維持美光與 SanDisk「增持」評等。Moore 指出,TurboQuant 壓縮對象僅限 KV Cache 這一特定類型快取,而非整體記憶體用量,應視為「常態性的生產力提升」。富國銀行分析師 Andrew Rocha 同樣援引傑文斯悖論指出:效率提升壓低成本後,反而可能刺激更大規模 AI 部署,終將拉抬記憶體總需求。

舊論文、新包裝:AI 研究到市場敘事的傳導鏈風險

據技術部落客 Ben Pouladian 分析,TurboQuant 論文早在 2025 年 4 月即已公開,並非全新研究。3 月 24 日谷歌透過官方部落格重新包裝推廣,市場卻視之為突破性進展並據此定價。這種「舊論文、新發布」的推廣策略,疊加論文中潛在的實驗偏差,凸顯 AI 研究自學術論文至市場敘事傳導鏈中的系統性風險。

對 AI 基礎設施投資者而言,當一篇論文聲稱達成「數個數量級」性能提升時,首要質疑應是:基準對比的實驗條件是否公平、透明、可重現。

高健揚團隊已明確表示將持續推動問題之正式解決。截至目前,谷歌方面尚未就公開信中各項具體指控作出正式回應。